2019年3月27日,计算机领域最高奖项“图灵奖”颁给了深度学习领域的三大巨头——加拿大蒙特利尔大学教授约书亚·本吉奥(Yoshua Bengio)、谷歌副总裁兼多伦多大学名誉教授杰弗里·辛顿(Geoffrey Hinton)以及纽约大学教授兼 Facebook首席AI科学家杨立昆(Yann LeCun)。

图灵奖,通常被称为“计算机界的诺贝尔奖”,由Google提供资金支持,奖金为100万美元。它以英国数学家Alan M. Turing的名字命名,图灵发现了计算机的数学基础和及其运行限制。

如今深度学习技术在很多领域都有着深入的应用。比如近几年发生的AlphaGO大胜围棋冠军柯洁,AlphaStar在《星际争霸2》游戏中击败3位职业选手。另外,在我们的生活中,图像识别、语言翻译、社交机器人、AI医疗,甚至手机的美颜相机,背后都有深度学习的影子。

然而三十多年前,深度学习的研究者却被其他人称为“异类”。就是这一小撮人坚持这个研究方向,坚信模拟神经网络的学习算法可以改变世界,并改变整个人类的命运。杰弗里·辛顿的至交好友、全球十大AI科学家之一的特伦斯·谢诺夫斯基在新书《深度学习:智能时代的核心驱动力量》中,详细回顾了深度学习技术的发展历程,也讲述了三位图灵奖得主在深度学习研究过程中的贡献。

什么是深度学习?

深度学习指的是用计算机模拟神经元网络,以此逐渐“学会”各种任务的过程,比如识别图像、理解语音甚或是自己做决策。这项技术的基础是所谓的“人工神经网络”,它是现代人工智能的核心元素。人工神经网络和真实的大脑神经元工作方式并不完全一致,事实上它的理论基础只是普通的数学原理。但是经过训练后的人工神经网络却可以完成很多任务,比如识别照片中的人物和物体,或是在几种主要语言之间互相翻译等等。

深度学习的起点

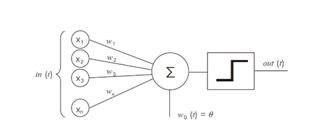

20世纪50年代,尽管人们对大脑功能缺乏足够的了解,但神经网络的 AI 先驱们依然依靠着神经元的绘图以及它们相互连接的方式,进行着艰难的摸索。康奈尔大学的弗兰克·罗森布拉特是最早模仿人体自动图案识别视觉系统架构的人之一。他发明了一种看似简单的网络感知器(perceptron),这种学习算法可以学习如何将图案进行分类,例如识别字母表中的不同字母。

图1 单层感知器

感知器是具有单一人造神经元的神经网络,它有一个输入层,和将输入单元和输出单元相连的一组连接。感知器的目标是对提供给输入单元的图案进行分类。在人工神经网络领域中,感知器也被指为单层的人工神经网络,以区别于较复杂的多层感知器(Multilayer Perceptron)。 作为一种线性分类器,(单层)感知器可说是最简单的前向人工神经网络形式。尽管结构简单,感知器能够学习并解决相当复杂的问题。

神经网络的寒冬

神经网络的早期历史,其实就是一个不大但颇具影响力的团队,如何能够将研究方向带离正轨的案例。在1969 年发表的数学专著《感知器》(Perceptrons)。他们明确的几何分析表明,感知器的能力是有限的:它们只能区分线性可分的类别。

这本书的封面展示了明斯基和帕普特证明的感知器无法解决的几何问题。尽管在书的末尾,明斯基和帕普特考虑了将单层感知器进行泛化成为多层感知器的前景,但他们怀疑可能没有办法训练这些更强大的感知器。不幸的是,许多人对他们的论断坚信不疑,于是神经网络这个研究领域渐渐被人们遗忘,直到20 世纪 80 年代,新一代神经网络研究人员开始重新审视这个问题。

图2 马文·明斯基和西摩尔·帕普特,照片拍摄于1971年

毫无疑问,其结果导致了网络学习领域的寸草不生。在明斯基和帕普特的书中,这种毫无根据的“直觉”对神经网络学习的发展产生了令人不寒而栗的影响,让一代人的研究就此停滞不前。